第1章 NVIDIAにおけるAIデータセンター事業の収益構造と成長ドライバー

北米を中心とするAIデータセンター市場は、従来のデータ保管や汎用コンピューティングの場から、インテリジェンスを生成する「AI工場(AI Factory)」へとその本質を変容させている。このパラダイムシフトを主導するNVIDIAは、単なる半導体ベンダーの枠を超え、ハードウェア、ソフトウェア、ネットワーキングを統合した「垂直統合型システム・プロバイダー」として、空前の収益力を誇っている。2026会計年度の通期売上高は前年比65%増の2,159億ドルに達し、その大半を占めるデータセンター部門の売上は1,937億ドルを記録した 。本章では、同社の売上および営業利益を最大化させている収益ドライバーの正体を、最新の製品ライフサイクルと推論経済学の観点から突き止める。

1.1 「システムとしての製品」への移行と単価の劇的向上

NVIDIAの収益最大化の源泉は、販売単位の「ラック化(Rack-scale System)」にある。かつての同社は、数千ドルのGPUチップをPCIeカードとして販売し、サーバーメーカーがそれを筐体に組み込むモデルを主としていた。しかし、Blackwell(GB200)以降、そして2026年に発表された次世代プラットフォーム「Vera Rubin(ヴェラ・ルービン)」において、同社は72個以上のGPU、CPU、スイッチ、液冷マニホールドを統合したラックシステム「GB200 NVL72」を最小の提供単位へと押し上げている 。

このシフトにより、単体のチップ販売に比べて、1回の受注あたりの平均販売単価(ASP)が飛躍的に増大した。例えば、1GW級のデータセンターで採用されるGB200/NVL72ラック1基のコストは約590万ドルに達し、その内訳のうち計算ハードウェアが340万ドル、物理インフラ部分が250万ドルを占める 。NVIDIAはこの統合システムを提供することで、本来は外部のサプライヤーに流れていた「ラック内の配電・冷却・筐体」の付加価値までも自社で回収する、あるいは強力な指定部品(NVIDIA認定品)としてコントロール下に置いているのである 。

1.2 ネットワーキング部門の「第二の収益柱」化

データセンター売上のうち、GPU計算リソース以外のネットワーキング製品が占める割合が急速に高まっている。2026年度第4四半期、データセンター売上623億ドルのうち、ネットワーキング売上は110億ドルに達した 。AIデータセンター、特に10万個以上のGPUを連結する大規模クラスターにおいては、個々のチップの性能よりも、チップ間のデータ転送速度が計算効率のボトルネックとなる。

NVIDIAは、買収したMellanoxの技術をベースにした「InfiniBand」に加え、AIワークロードに最適化したEthernet「Spectrum-X」を展開している。Meta、Microsoft、Oracle、xAIといった北米の主要顧客は、ギガスケール(GW級)のAI工場建設にあたり、計算機とセットでNVIDIAのネットワーキング・ファブリックを導入している 。これにより、NVIDIAは「計算」と「通信」の両面からマージンを抽出しており、これが営業利益率60〜70%という驚異的な数値を維持する強力なドライバーとなっている 。

1.3 推論経済学によるROIの正当化と継続需要

NVIDIAの収益を支えるもう一つの重要な要因は、市場の主軸が「モデルの学習(Training)」から「大規模な推論(Inference)」へと移行している点にある。ジェンセン・ファンCEOは、推論を「収益を生む製造ライン」と定義している 。ハイパースケーラーにとって、AIインフラへの巨額投資を正当化するためには、生成されたAIトークンをサービスとして販売し、早期にキャッシュフローを回収する必要がある。

NVIDIAがGTC 2026で発表した「Vera Rubin」は、Blackwell比でワットあたりの推論性能を10倍に向上させている 。さらに、ソフトウェアスタック「Dynamo 1.0」は、既存のハードウェアを変更することなく推論性能を最大7倍に引き出す 。このように、顧客の「トークン生成コスト(Cost per Token)」を劇的に下げることで、顧客側に高いROIをもたらし、次世代機への買い替えサイクルを加速させている。これが、一度限りの設備投資(CapEx)ではなく、継続的なインフラ刷新需要を生み出す収益構造の正体である。

第2章 北米AIデータセンターのCapEx構造:1GW級ファクトリーの真実

北米市場において現在進行している「1GW級AIデータセンター」は、従来の企業向けDCや汎用クラウドDCとは、そのコスト構成において決定的に異なる。巷間では「NVIDIAのGPUサーバーが投資の5割を占める」という言説が流布しているが、最新のリサーチデータに基づくと、その内訳はより複雑で、かつインフラ設備への要求が極端に高まっていることが判明した。

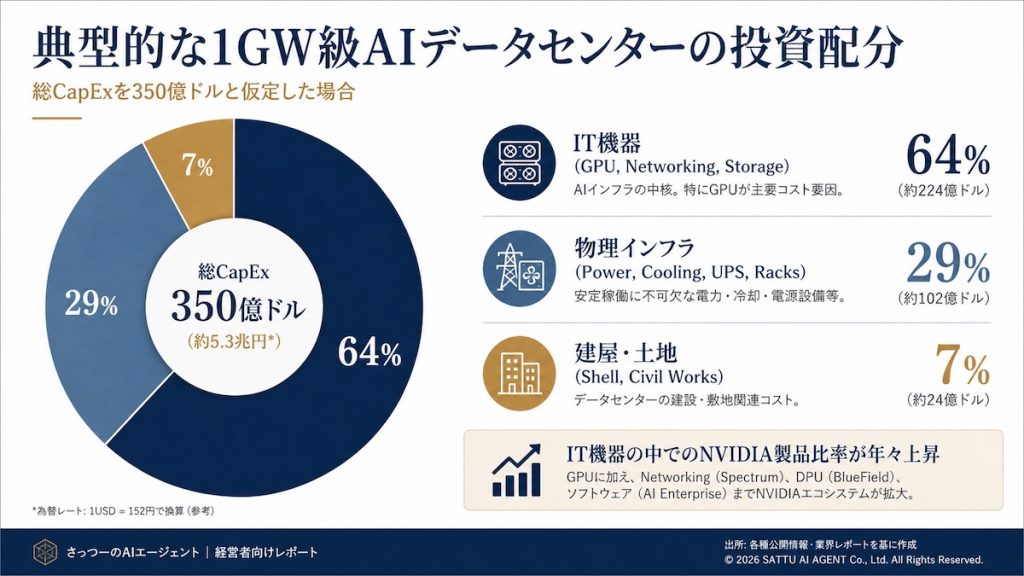

2.1 1GW級AIデータセンターの総投資額と基本構成

Bernsteinの分析によると、1GW(1,000MW)のAIデータセンター容量を構築するための総CapExは約350億ドルに達する。これはNVIDIAが公式に示唆する500億〜600億ドルという数字よりは保守的だが、それでも空前の規模である 。一方、JLLの予測では、2030年までに100GWの新設供給が必要となり、その資産価値創造には1.2兆ドルの投資が求められるとしている 。

1GW級センターのコスト構成を、建屋建設、インフラ設備(Warm Shell)、IT機器の3つのレイヤーで分析すると、以下の表のような比率になる。

| コストレイヤー | 構成比 (%) | 1Wあたりのコスト | 内容 |

| IT機器 | 64.0% | 約$17.50/W | GPUサーバー、ネットワーク機器、ストレージ |

| 物理インフラ (Warm Shell) | 29.1% | 約$10.00/W | 受配電、冷却、バックアップ、ラック |

| 建屋構造 (Shell) | 6.9% | 約$1.90/W | 土木、建築外装、基礎工事 |

このデータから、従来の「GPUサーバー5割」という認識は過小評価であり、実際にはIT機器全体で投資の6割以上、その大部分をNVIDIAの計算・ネットワークシステムが占めていることが分かる。特に、AI特化型のラック構成では、物理インフラのコストも従来の1Wあたり7ドル程度から10ドル以上へと40%上昇しており、インフラ層自体の高度化も顕著である 。

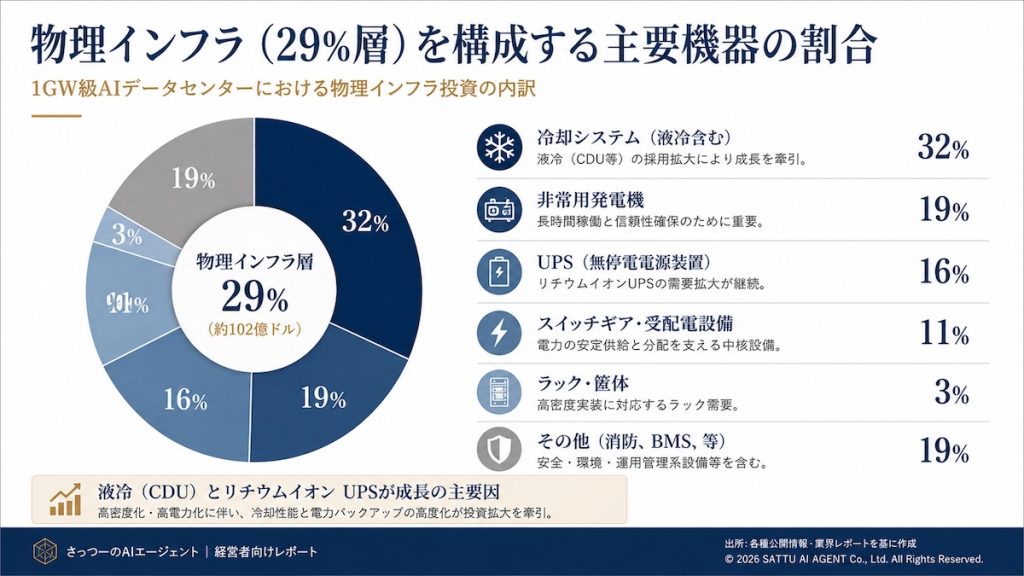

2.2 物理インフラ(29.1%)層の機器別詳細内訳

日本の電機メーカーが最も注目すべき、物理インフラ層(1GWあたり約100億ドル規模)の詳細な機器構成比を以下に示す。これは「建屋の中」の設備一式に焦点を当てたものである。

| 設備項目 | 構成比 (%) | 主な機能とAIによる変化 |

| 冷却システム (Cooling) | 32.0% | 液冷(CDU)が空冷(CRAH)を補完・代替。最大の投資項目 |

| バックアップ発電機 (Gen) | 19.0% | ディーゼル・天然ガスの併用。グリッド不安定化への対策 |

| UPS (無停電電源装置) | 16.0% | リチウムイオン化と高密度化が進行。800V DC化の議論の中心 |

| スイッチギア (Switchgear) | 11.0% | 回路保護と負荷管理。高圧受電の増加により価値上昇 |

| ラック (Racks) | 3.0% | 100kW/ラック以上に耐える構造。配電・冷却マニホールド一体化 |

| その他 (消防・BMS・セキュリティ) | 19.0% | 建物管理システム(BMS)のAI最適化が進行 |

特に注目すべきは、冷却設備がインフラ投資の32%を占めている点である。AIサーバーは電力の99.5%を熱として放出するため、ラック密度が50kWを超えると、従来の空気冷却では物理的に不可能となり、ダイレクト・トゥ・チップ(液冷)が業界標準となっている 。また、UPSや配電設備においても、後述する「800V DC」への移行が、今後の構成比に大きな影響を与えると予測される。

2.3 GPUサーバー単価と「5割説」の再検証

巷間で言われる「GPUサーバー5割」の真偽を確かめるべく、Bernsteinが示したGB200/NVL72ラック1基(約5.9Mドル)の内訳を再確認する。この単一ラック内において、計算ハードウェア(GPU/CPU)は3.4Mドル、それ以外の物理インフラ(電源ユニット、冷却配管、筐体)は2.5Mドルである 。つまり、ラック単位で見れば、サーバー本体とインフラの比率は「57対43」程度であり、概ね「5割強」がNVIDIAの計算機側であるという通説に近い。

しかし、データセンター全体で見た場合、ネットワーキング(InfiniBand等)のコストがCapexの約13%を占め、さらにNVIDIAの粗利益率(約70%)を考慮すると、全データセンターCapExの約29%が「NVIDIAの利益」として吸い上げられているという驚異的な推計もある 。結論として、サプライヤーとしての日本企業が戦うべき土俵は、残りの30〜40%の「物理インフラ」および「建設」の領域であるが、ここでもNVIDIAの認定(MGX等)が事実上の標準となりつつある。

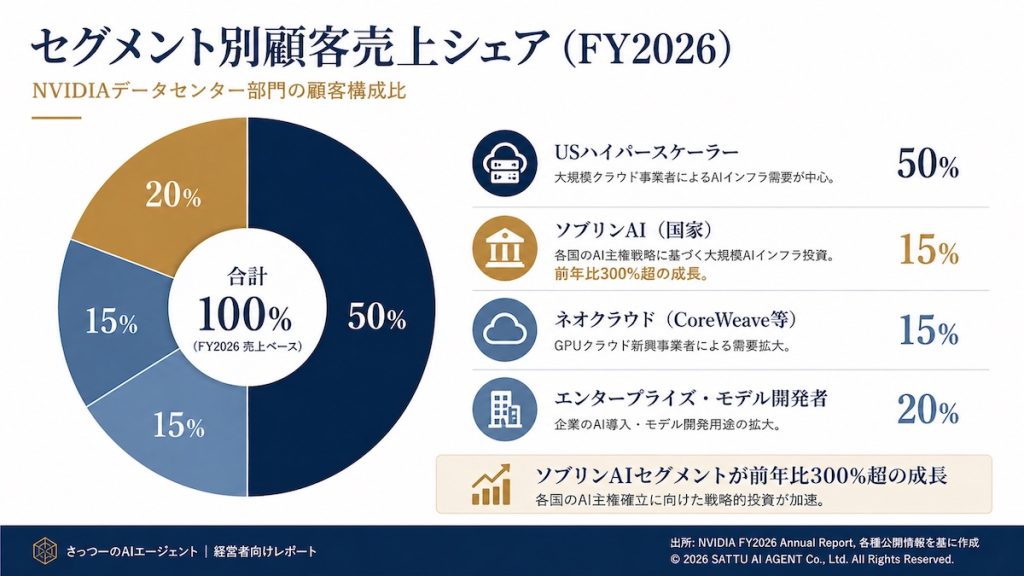

第3章 AIデータセンター市場の「顧客」構成比:ハイパースケーラーの独走と多極化

ジェンセン・ファンCEOがGTC 2026で述べた「売上の6割〜7割がハイパースケーラー」という趣旨の発言は、同社の受注パイプラインの実態を如実に表している。しかし、2026会計年度の確定決算に基づく実際の売上比率を精査すると、顧客構成はより戦略的に「多極化」が進んでいることがわかる。

3.1 顧客セグメント別の構成比

NVIDIAの最新の財務データおよびCFOのコメントに基づくと、顧客構成比は概ね以下の通りである。

| 顧客セグメント | 売上構成比 (%) | 特徴と動向 |

| ハイパースケーラー (US) | 約 50.0% | Microsoft, Amazon, Google, Metaが中心。巨額の継続投資 |

| ソブリンAI (国家プロジェクト) | 約 15.0% | 前年比3倍の300億ドル超へ急成長。UK, フランス, シンガポール等 |

| AI特化型クラウド (Neo-Clouds) | 約 15.0% | CoreWeave, Lambda, Nebiusなど。NVIDIAの戦略的供給先 |

| エンタープライズ & AIモデル開発者 | 約 20.0% | OpenAI, Anthropic等の開発者および大手金融・製薬企業 |

ハイパースケーラーは依然として最大の顧客群であるが、NVIDIAは「単一顧客への依存リスク」を回避するため、ソブリンAIや企業向け需要の拡大を強力にプッシュしている。特にソブリンAI(国家AI)セグメントは、2026年度に売上が3倍以上に急増しており、自国のデータの安全性を確保したい各国政府による「国家インフラ」としてのAI工場建設が、米国のハイパースケーラーに次ぐ強力な需要層となっている 。

3.2 1兆ドルの受注パイプラインの正体

GTC 2026で最も注目を浴びたのは、ジェンセン・ファンが示した「1兆ドル(約150兆円)規模の受注パイプライン(Order Pipeline)」という数字である 。これは単なる希望的観測ではなく、ハイパースケーラー、各国政府、および大手企業からの「Blackwell」および「Vera Rubin」に対する確定済みの注文や供給合意を積み上げたものである 。

この1兆ドルの構成要素を見ると、AIが単なるソフトウェアブームではなく、「計算インフラの全面的な置き換え」であることを示唆している。これまで世界に蓄積されてきた1兆ドル規模の汎用データセンター設備が、今後数年をかけてアクセラレーテッド・コンピューティング(AI工場)へと置換されるプロセスそのものが、NVIDIAの受注残となっているのである 。

第4章 北米AIデータセンター市場のエコシステム:8つの主要レイヤー

北米におけるAIデータセンター市場は、極めて高度に分業化され、かつ特定企業への集中が進むエコシステムを形成している。このエコシステムを理解することは、日本企業がサプライヤーとしてどこに参入障壁を築くべきかを判断する上で不可欠である。

4.1 エコシステムの構成マップ

北米AIインフラ市場は、大きく分けて以下の8つのセグメントで構成されている。

| セグメント | 主要プレーヤー (例) | AI factoryにおける役割 |

| GPU/アクセラレータ | NVIDIA, AMD, Intel, Groq, Cerebras | 計算リソースの提供。NVIDIAがシェア9割 |

| 高速ネットワーキング | Broadcom, Cisco, Arista, NVIDIA(Mellanox) | 超低遅延・広帯域の通信ファブリック |

| GPUクラウド | AWS, Azure, GCP, CoreWeave, Lambda | 企業のインフラ調達をOpEx化する提供基盤 |

| AI最適化ストレージ | WEKA, Vast Data, DDN, Pure Storage, IBM | 大規模データの高速ローディングとチェックポイント保存 |

| 次世代冷却設備 | Vertiv, Schneider, CoolIT, Submer | 100kW/ラック以上の熱処理。液冷への完全移行 |

| 電力管理・配電 | Eaton, ABB, Delta Electronics | グリッド連携、800V DC配電、バックアップ電源 |

| メモリ技術 (HBM) | SK Hynix, Samsung, Micron | GPUの帯域不足(メモリの壁)を解消する広帯域メモリ |

| MLOps/オーケストレーション | LangChain, Weights & Biases | ソフトウェア層での計算リソース最適化 |

4.2 物理インフラの「3強」と日本の競合状況

北米市場において、日本の電機メーカーが直接競合、あるいは協調すべき相手は、インフラ三強(Vertiv, Schneider Electric, Eaton)である。

- Vertiv (バーティブ): 精密冷却で23%のシェアを誇り、Liebertブランドで知られる。NVIDIAの最も密接なパートナーであり、液冷CDU(冷却水分配装置)において事実上の標準を握っている 。

- Schneider Electric (シュナイダーエレクトリック): 電力管理からITインフラまでを統合した「EcoStruxure」を展開。AI向け液冷専門のMotivairを買収し、NVIDIAのデジタルツイン環境(Omniverse)を活用した設計でも先行している 。

- Eaton (イートン): 北米の電力網(グリッド)との繋がりに強みを持ち、800V DC配電の標準化(OCP)を推進。グリッド接続の遅延を解消するためのマイクログリッド・ソリューションをハイパースケーラーに売り込んでいる 。

これら三強は、単に「機器」を売っているのではない。NVIDIAの最新アーキテクチャ(Vera Rubin等)に合わせて、検証済みのリファレンスデザイン(認定設計図)をセットで提供することで、顧客の「導入スピード」という最大の痛みを解決している 。

第5章 日本の電機メーカーへの戦略的示唆:参入すべき「技術的特異点」

日本の東証プライム上場企業のデータセンター事業部長が、北米市場での競争に勝ち残る、あるいはサプライヤーとして強固な地位を築くために注目すべき領域は、以下の4点に集約される。これらは、単なるスペックの向上ではなく、AI特有の課題に対する「構造的な解決策」である。

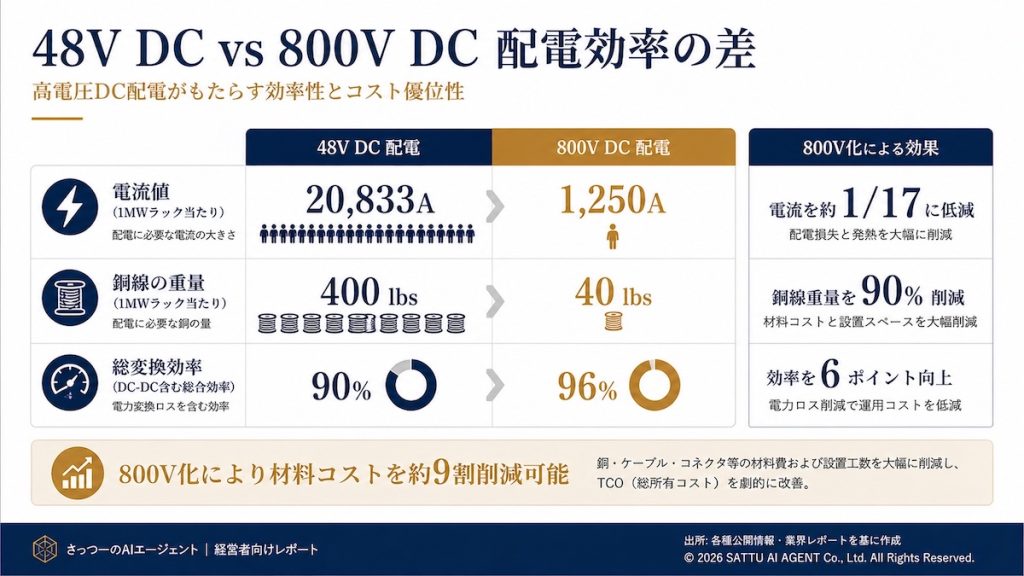

5.1 800V DC配電への歴史的転換

現在のAIデータセンターにおいて、電力密度の向上は配電システムの物理的限界を露呈させている。これまで主流だった48V DC分配では、1MWのラックに電力を送るために2万アンペアを超える電流が必要となり、銅線の太さと発熱(抵抗損失)が耐えられないレベルに達している。

そこで浮上しているのが「800V DC配電」である。

- メリット: 電流を95%削減でき、銅の使用量を従来の10分の1に減らせる。変換損失も低減し、全体効率を90%から96%へと引き上げることが可能である 。

- チャンス: EatonやDelta ElectronicsがGTC 2026で800V対応機器を大々的に展示したが、まだデファクトスタンダードは確定していない。日本のパワー半導体技術(SiC/GaN)を活かした、高効率・超小型のDC-DCコンバータや、高圧直流遮断器などは、北米メーカーに対する大きな武器となる 。

5.2 「45℃温水供給」と高度な熱管理

NVIDIAの最新アーキテクチャは、冷却水の供給温度を「45℃」にまで引き上げる「Warm-Water Inlet」を提唱している 。

- 意味: 冷却水をチラー(冷凍機)で冷やす必要がなくなり、外部の空気との熱交換だけで済む「フリークーリング」が一年中可能になる。これにより、データセンターのPUE(電力使用効率)を劇的に改善できる 。

- 課題: しかし、45℃の水でチップの熱を奪うためには、精密な流体制御と、コールドプレート内の微細流路(マイクロチャネル)設計が求められる。また、冷却水が漏れた際の被害はAIサーバーの巨額な資産を直撃するため、極めて高い気密性と信頼性が要求される。日本の精密加工・バルブ技術が活きる領域である 。

5.3 グリッド接続遅延を解決する「オンサイト発電」と水素技術

北米の主要DC拠点(バージニア、テキサス等)では、電力網への接続までに3年〜7年を要する事態となっている 。

- ソリューション: ハイパースケーラーは、グリッドの完成を待たず、自前で発電する「オンサイト発電」への投資を加速させている。三菱パワー(三菱重工)が北米で展開している水素混焼ガスタービンや、小型モジュール炉(SMR)との連携は、電力供給自体を「製品」として提供できる日本の電機メーカーにとって最大の差別化ポイントとなる 。

- マイクログリッドのインテリジェント化: データセンターを一つの「グリッド」として捉え、再生可能エネルギー、蓄電池、自家発電をAIで最適制御するエネルギー管理システム(EMS)の需要は極めて高い。

5.4 ソフトウェア定義のインフラ:NVIDIAプラットフォームへの適合

NVIDIAは今回、「Dynamo 1.0」や「NemoClaw」といったソフトウェア層での囲い込みを鮮明にした 。

- 示唆: 今後のインフラ機器(UPS、空調機、スイッチギア)は、単に「電気が流れる」「冷える」だけでは不十分である。NVIDIAの「Omniverse」や「DSX Exchange」と連携し、リアルタイムで電力負荷や熱分布のデータをフィードバックできる「デジタルツイン対応」が必須条件となる 。機器のステータスをAPI経由でNVIDIAの管理スタックに統合できるソフトウェア開発力が、ハードウェアの選定基準を左右するようになる。

第6章 図表構成要素:Gemini Pro Nanobanana 2用指示データ

以下は、本レポートの核心的なデータを視覚化するためのテキストデータである。Gemini Pro Nanobanana 2を用いてグラフ化する際の構成要素として活用されたい。

6.1 図表:1GW級AIデータセンターのCapEx内訳

- タイトル: 典型的な1GW級AIデータセンターの投資配分

- データ構造:

- IT機器 (GPU, Networking, Storage): 64%

- 物理インフラ (Power, Cooling, UPS, Racks): 29%

- 建屋・土地 (Shell, Civil Works): 7%

- 注釈: 総CapExを350億ドルと仮定した場合。IT機器の中でのNVIDIA製品比率が年々上昇。

6.2 図表:物理インフラ層内の機器別売上比率

- タイトル: 物理インフラ(29%層)を構成する主要機器の割合

- データ構造:

- 冷却システム: 32%

- 非常用発電機: 19%

- UPS (無停電電源装置): 16%

- スイッチギア・受配電設備: 11%

- ラック・筐体: 3%

- その他 (消防, BMS, 等): 19%

- 注釈: 液冷(CDU)とリチウムイオンUPSが成長の主要因。

6.3 図表:NVIDIAデータセンター部門の顧客構成比 (FY2026)

- タイトル: セグメント別顧客売上シェア

- データ構造:

- USハイパースケーラー: 50%

- ソブリンAI (国家): 15%

- ネオクラウド (CoreWeave等): 15%

- エンタープライズ・モデル開発者: 20%

- 注釈: ソブリンAIセグメントが前年比300%超の成長。

6.4 図表:配電電圧と材料効率の比較

- タイトル: 48V DC vs 800V DC 配電効率の差

- データ構造:

- 電流値 (1MWラック当たり): 48V = 20,833A / 800V = 1,250A

- 銅線の重量: 48V = 400 lbs / 800V = 40 lbs

- 総変換効率: 48V = 90% / 800V = 96%

- 注釈: 800V化により材料コストを9割削減可能。

結論

NVIDIAの北米AIデータセンター事業の研究から明らかになったのは、AIインフラ市場はもはや既存のデータセンターの延長線上にはない、全く新しい「産業用計算プラットフォーム」への進化である。

NVIDIAは、チップ単体ではなく「ラック単位の統合システム」を販売することで収益を最大化し、さらにネットワーキングと推論用ソフトウェアで顧客を囲い込む「1兆ドルのパイプライン」を構築している 。ハイパースケーラーが投資の約5割を支えているが、ソブリンAIやAI特化型クラウドといった新興の需要層が急速に台頭しており、市場は多極化のフェーズに入っている 。

日本企業にとっての商機は、NVIDIAが手を出さない(あるいは他社に委ねている)「建屋の中の物理インフラ」に存在する。しかし、そこでの戦い方は、単なる単品の機器納入ではない。800V DC配電、45℃温水冷却、そしてグリッドを介さない自家発電技術を組み合わせ、NVIDIAのデジタル管理スタックに完全適合した「統合インフラ・ソリューション」を、北米のハイパースケーラーや各国の政府に直接提案する力こそが、今後10年の勝敗を決する。

AIインフラの「ゴールドラッシュ」において、NVIDIAが掘削機(GPU)を売る者であるなら、日本の電機メーカーは、その採掘現場に必要な「電力」と「酸素(冷却)」を、最も効率的かつ安定的に供給する「生命維持インフラの提供者」としての地位を確立すべきである。

引用文献

- What NVIDIA GTC 2026 Reveals About Keynotes, Spectacle, and Scale, 4月 27, 2026にアクセス、 https://cardboard-spaceship.com/blog/nvidia-gtc-2026-keynote/

- NVIDIA Announces Financial Results for Fourth Quarter and Fiscal 2026, 4月 27, 2026にアクセス、 https://nvidianews.nvidia.com/news/nvidia-announces-financial-results-for-fourth-quarter-and-fiscal-2026

- Nvidia $1T Order Pipeline: Jensen Huang GTC Keynote – Digital Applied, 4月 27, 2026にアクセス、 https://www.digitalapplied.com/blog/nvidia-1-trillion-order-pipeline-jensen-huang-gtc-keynote

- What is Competitive Landscape of NVIDIA Company? – MatrixBCG …, 4月 27, 2026にアクセス、 https://matrixbcg.com/blogs/competitors/nvidia

- How much does a GW of data center capacity actually cost By …, 4月 27, 2026にアクセス、 https://www.investing.com/news/stock-market-news/how-much-does-a-gw-of-data-center-capacity-actually-cost-4314046

- NVIDIA Q3 FY 2026: Record Data Center Revenue, Higher Q4 Guide – The Futurum Group, 4月 27, 2026にアクセス、 https://futurumgroup.com/insights/nvidia-q3-fy-2026-record-data-center-revenue-higher-q4-guide/

- NVIDIA Q4 FY 2026 Earnings Highlight Durable AI Infrastructure …, 4月 27, 2026にアクセス、 https://futurumgroup.com/insights/nvidia-q4-fy-2026-earnings-highlight-durable-ai-infrastructure-demand/

- NVIDIA Announces Financial Results for Third Quarter Fiscal 2026, 4月 27, 2026にアクセス、 https://nvidianews.nvidia.com/news/nvidia-announces-financial-results-for-third-quarter-fiscal-2026

- Nvidia GTC 2026: 8 takeaways from Huang’s analyst meetings | Constellation Research, 4月 27, 2026にアクセス、 https://www.constellationr.com/insights/news/nvidia-gtc-2026-8-takeaways-huangs-analyst-meetings

- NVIDIA GTC 2026: Live Updates on What’s Next in AI, 4月 27, 2026にアクセス、 https://blogs.nvidia.com/blog/gtc-2026-news/

- Nvidia GTC 2026: We’re a software company too | Constellation Research, 4月 27, 2026にアクセス、 https://www.constellationr.com/insights/news/nvidia-gtc-2026-were-software-company-too

- NVIDIA Enters Production With Dynamo, the Broadly Adopted …, 4月 27, 2026にアクセス、 https://nvidianews.nvidia.com/news/dynamo-1-0

- 2026 Global Data Center Outlook – JLL, 4月 27, 2026にアクセス、 https://www.jll.com/en-us/insights/market-outlook/data-center-outlook

- Inside the $11 Billion Data Center: The Real Cost of Powering AI …, 4月 27, 2026にアクセス、 https://www.leanrs.com/insights/data-center-equipment-growth

- 7 data center trends to watch—as seen at Data Centre World London 2026 – IoT Analytics, 4月 27, 2026にアクセス、 https://iot-analytics.com/7-data-center-trends-to-watch/

- AI Data Center Cooling Requirements 2026: Complete GPU Thermal Guide – SLYD, 4月 27, 2026にアクセス、 https://slyd.com/guides/cooling-requirements

- Forecasting Data Center Capacity Increases in the AI Era – ABI Research, 4月 27, 2026にアクセス、 https://www.abiresearch.com/blog/data-center-capacity-growth-forecast

- The 2026 AI Infrastructure Market Map: Segments, Players, and Where the Growth Is, 4月 27, 2026にアクセス、 https://www.castlerockdigital.com/insights/ai-infrastructure-market-landscape-2026

- GTC 2026: Moving from Chip Launches to Infrastructure Architecture …, 4月 27, 2026にアクセス、 https://www.delloro.com/gtc-2026-moving-from-chip-launches-to-infrastructure-architecture/

- Vertiv vs Schneider vs Eaton: Cooling Solutions Comparison for AI Data Centers – Introl, 4月 27, 2026にアクセス、 https://introl.com/blog/vertiv-schneider-eaton-cooling-solutions-comparison-ai-data-centers

- Switchgear, Cables, and Gensets: The Quiet Winners of the AI Data Center Boom – Medium, 4月 27, 2026にアクセス、 https://medium.com/@_mh/switchgear-cables-and-gensets-the-quiet-winners-of-the-ai-data-center-boom-1c01bd41a67c

- Scaling AI Sustainably: High-Voltage DC Power for Next-Generation …, 4月 27, 2026にアクセス、 https://article.murata.com/en-us/article/scaling-ai-sustainably

- Bridging the present to the future: Rack-level DC power distribution for legacy AC designs, 4月 27, 2026にアクセス、 https://www.vertiv.com/en-us/about/news-and-insights/articles/blog-posts/bridging-the-present-to-the-future-rack-level-dc-power-distribution-for-legacy-ac-designs/

- OCPOAISYSTEM LIQUID COOLING GUIDELINES – Open Compute Project, 4月 27, 2026にアクセス、 https://www.opencompute.org/documents/oai-system-liquid-cooling-guidelines-in-ocp-template-mar-3-2023-update-pdf

- Newly added US data center capacity slows down considerably in Q4 2025, as market struggles to keep up with explosive demand | Wood Mackenzie, 4月 27, 2026にアクセス、 https://www.woodmac.com/press-releases/newly-added-us-data-center-capacity-slows-down-considerably-in-q4-2025-as-market-struggles-to-keep-up-with-explosive-demand/

- Data Centers in a Grid Constrained World: Challenges and Opportunities for Canada, 4月 27, 2026にアクセス、 https://economics.td.com/ca-data-centers-and-grid-constraints

- Solving the Data Center Power Dilemma, 4月 27, 2026にアクセス、 https://power.mhi.com/regions/amer/insights/solving-data-center-power-dilemma

- 2026 Data Center Power Report – Bloom Energy, 4月 27, 2026にアクセス、 https://www.bloomenergy.com/wp-content/uploads/2026-power-report.pdf

Safer AI Agents & Assistants with OpenClaw | NVIDIA NemoClaw, 4月 27, 2026にアクセス、 https://www.nvidia.com/en-us/ai/nemoclaw/