Executive Summary

米国のデータセンターは、生成AIとGPUアクセラレーテッド・サーバーの急増を背景に、電力・冷却・ネットワークを中心とする「建屋内インフラ(Data Center Infrastructure)」の要求仕様が根本から変わりつつあります。

- AIデータセンターの急成長:米国データセンターの電力消費は2023年に約176TWh(米国電力の約4.4%)に達し、2028年には約325〜580TWh(約6.7〜12%)へ拡大するシナリオが示されています。

- GPUクラスタの巨大化:AIトレーニングは「多数GPUを同期させて一つの計算機として動かす」方向へ進み、ラック単位からデータホール全体まで、ネットワーク/電力/冷却を“単一システム”として最適化する設計が前提になります。

- 従来クラウドDCとの違い:一般的なデータセンターでは“平均ラック密度はまだ1桁kWが中心”である一方、AIラックは数十kWが標準化し、100kW級(将来はさらに上)を視野にした設備計画が必要です。

- 電力密度の急上昇:例として、NVIDIA推奨のDGX H100高密度配置では「4台/ラック=40.8kW(サーバーのみ)」が基本単位になり、電源冗長・配電方式(415VAC三相等)まで設計条件が規定されます。

- 液冷の普及:全体としては空冷が依然多数派ですが、直接液冷(DLC)は「すでに利用22%・将来検討61%」という調査結果があり、空冷限界を意識した導入が加速しています。

- 主要プレイヤー:GPUサーバー(NVIDIA、Supermicro、Dell、HPE)、ネットワーク(NVIDIA Networking、Arista、Cisco)、電源(Vertiv、Schneider Electric、Eaton)、冷却(Vertiv、Schneider Electric、CoolIT、Submer)、管理ソフト(Schneider Electric、Vertiv、Siemens)といった垂直統合/協業が進み、「参入余地は“単品供給”より“統合・検証済みアーキテクチャ”側で膨らむ」構図です。

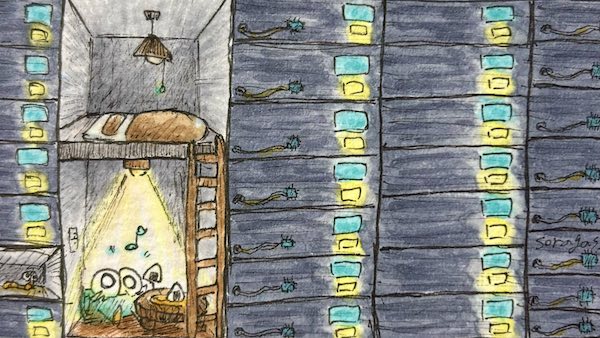

AIデータセンター設備の基本構造

AIデータセンターの建屋内設備は、(1)高密度GPUサーバー群、(2)それを束ねる超高速ネットワーク、(3)高電力を低損失で運ぶ受配電・UPS・ラック配電、(4)発熱を安定除去する冷却(空冷+液冷)、(5)運用を可視化・最適化する管理システム、の「連鎖」で設計されます。特にAIでは、どこか一つの制約(例:冷却能力)が他要素(例:ラック密度やネットワーク配線距離)を直ちに制約するため、“電力・冷却・床面積の経済(trade-off)”を前提に全体最適する必要があります。

ユーザー指定の構造に沿うと、概念的には以下です。

GPUサーバー → ネットワーク → 電源設備 → 冷却設備 → データセンター管理システム(監視・制御・最適化)

従来のクラウドデータセンター(汎用CPU中心、仮想化・分散ワークロード中心)との決定的な違いは、AIトレーニングが「多数GPUの同期運転(集団通信・同期待ち)が性能を左右」し、さらに電力も“平均”より“ピーク/変動”が設備設計を決める点です。AIではラック電力が数十kW〜100kW級に上がり、空冷だけでの維持が困難になり、電源・冷却・制御の統合度(設計の一体化)が急速に高まります。

GPUサーバーインフラ

NVIDIA系AIサーバーは大きく、(A)DGX(完成品サーバー/ノード)、(B)HGX(8GPU等の“プラットフォーム”を各OEMが筐体化)に分かれます。DGX H100/H200は、最大10.2kW・6基電源(各3.3kW)・4+2冗長など、設備側が織り込むべき“電力の物理条件”が明示された代表例です。

AIクラスタは、単体ノード性能よりも「ノード間をつなぐスケールアウト(scale-out)性能」が重要です。NVIDIAのDGX SuperPOD設計では、スケーラブルユニット(SU)を基本ブロックとしてDGX H100を最大127台・GPU総数1,016規模まで拡張する構成が示され、設計・施工側は“このサイズの繰り返し(工業化)”を前提に、配電・配管・配線をモジュール化していきます。

GPUラックの電力消費は、従来DCの「数kW〜10kW級」を超えます。DGX H100の推奨高密度配置は4台/ラックで、サーバーだけで40.8kW(10.2kW×4)を要求します。さらに管理ラック、ネットワーク機器、ストレージ等も別途必要になるため、データホール設計では“IT負荷の局所集中”を前提に、配電経路(床下かバスウェイか等)と冷却方式(気流設計+液冷)を同時に決める必要があります。

OEM側では、Supermicroが「HGX H100/H200×8GPU」の液冷サーバー・ラックスケール構成(CDUやマニホールド等の液冷部材を含む)を提示しており、“サーバー筐体+液冷部材+ネットワーク”まで含むターンキー化が進んでいます。

DellのPowerEdge XE9680も、HGX H100/H200(SXM5・700W級GPU)など複数アクセラレータを選択可能な8GPU密集型サーバーとして仕様を公開しており、GPUのTDP上昇が「IT側の発熱・給電」を直接押し上げることが読み取れます。

HPEは、HPE Cray XD670が空冷またはダイレクト冷却(direct cooled)に対応し、8x H100/H200を搭載可能であることをQuickSpecsで示しています。 さらに同社は“100%ファンレス直接液冷アーキテクチャ”を打ち出し、冷却用電力の削減を訴求しています(※ベンダー主張)。

👉 NVIDIA現行世代 GPUサーバーの動向を深堀り調査するAIエージェント(米国)サンプルレポート公開中

ネットワークインフラ

AIデータセンターのネットワークは、(1)ノード内GPU間(scale-up:NVLink等)、(2)ノード間GPUクラスタ(scale-out:InfiniBandまたはEthernet/RoCE)、(3)フロントエンド/ストレージ/管理(OOB含む)という多層に分かれます。AI学習では集団通信(all-reduce等)と同期がボトルネックになりやすく、ネットワークは“帯域”だけでなく“遅延・ジッタ・輻輳制御・可観測性”が性能を左右します。

InfiniBandはHPC由来の低遅延・RDMA・ネットワーク内計算等を特徴とし、NVIDIA Quantum-2は最大400Gb/s級の“speeds and feeds”と、64×400Gb/sポート等のスイッチ仕様を公開しています。

一方、Ethernetは標準化と運用エコシステムの強みからAIクラスタでも急速に最適化が進み、NVIDIAはSpectrum-Xを「AI向け初のEthernetネットワーキング・プラットフォーム」と位置づけ、RoCE拡張やテレメトリ等を含む“フルスタック最適化”を訴求しています。

AristaのAIネットワーク導入ガイドでは、スケールアウト・ファブリックが分散AIワークロードに必須であり、典型的に「GPUあたりNIC 1枚(例:PCIe Gen5 x16 または400Gbps)」が要求される、と明確に述べています。 これは「GPU搭載数が増えるほど、ネットワークポート数・光モジュール数・配線量が爆発する」ことを意味し、データホールではケーブル経路・曲げ半径・ラック前後の作業性まで含めた設計が不可欠です。

Ciscoは、自社データセンター内に複数のAIクラスタを構築し、NVIDIA H100/H200 DGXとCisco Nexus 9000によるEthernetベースAIネットワーク設計・検証(RDMA/RoCEv2、集団通信、学習性能)を白書として公開しています。 さらにAIクラスタには、バックエンド(GPU間)、フロントエンド、ストレージ、OOB管理という複数ネットワークが共存する点も整理しており、運用設計(監視・自動化)まで含めた“ネットワーク・アーキテクチャ製品化”が進んでいることが分かります。

電源設備

AIデータセンターの電源設備は、単に「大電力を供給する」だけでなく、(1)高密度・高変動の負荷を安全に受け止める、(2)冗長性要件を満たしつつ配電損失と工事量を抑える、(3)運用で“可視化して制御する”という三点が焦点になります。米国ではデータセンター需要の増加が電力系統計画を揺さぶっており、電力制約が建設スケジュールを左右する局面が増えています。

建屋内の基本的な電源チェーンは、受電(中電圧)→変圧→低圧配電→UPS→フロアPDU/バスウェイ→ラックPDU→サーバーPSUです。AIではラック密度が上がるため、低圧側は三相(例:415VAC/400VAC)を前提に設計されやすくなります。NVIDIAのDGX SuperPOD設計ガイドは、DGX H100高密度ラック向けに「415VAC・32A・三相・N+1」を“望ましい配電”として挙げ、三相入力を分割して200–240VAC単相を供給するrPDU構成を説明しています。

AI特有の論点は“冗長性の組み方”です。DGX H100は内部電源が6基で、最低4基が通電していないとフル動作できません。 さらに「分散AIジョブでは1台の故障がジョブ全体停止につながる」ことが明記され、ラックへ最低3系統の電源供給(上流経路が独立)を推奨するなど、従来の2N思想だけでは成立しないケースが現実化しています。

将来方向としては、損失と銅量を抑えるための高電圧DCが“次の主戦場”です。NVIDIAは800VDC配電と多階層蓄電(ラック近傍の超短周期、施設レベルのBESS等)を組み合わせる構想を示し、1MW/ラック級までの拡張を視野に入れています。 EatonもNVIDIAと協業してHVDC(800V級)移行を支援すると発表しており、電源設備は「UPS/配電盤」から「DC変換+蓄電+バスバー+接続規格」へと、設計範囲が広がっています。

冷却設備

GPUクラスタの高密度化により、冷却は「空調設備」から「サーバーと一体で設計する熱輸送システム」へ変わっています。 実務的には、空冷をベースにしつつ、熱源近傍へ液体を近づける“ハイブリッド”が主流になりつつあります(ラック背面RDHx、D2C、場合により浸漬)。

Uptime Instituteの調査では、直接液冷(DLC)を「何らか使っている」組織は22%で、未使用だが将来検討が61%と、普及は“段階的だが確実”です。 また「空冷が高コスト/限界となりDLCが必要になるラック密度」は20〜29kWが最多(29%)で、30kW以上で必要とみる回答も続きます。 これは「DGX H100の40.8kW/ラック級が“空冷の延長線の外側”に入り始める」ことと整合します。

冷却方式の整理(建屋内設備として重要な要素):

- 空冷(CRAC/CRAH+気流設計):ホット/コールドアイル、封じ込め、ブランキング等で気流短絡を防ぐ。DGX SuperPODでも高密度ラックではアイルコンテインメント等の空気設計が強調されます。

- Direct-to-chip(D2C):GPU/CPUにコールドプレートを当て、CDU(Coolant Distribution Unit)/マニホールドで配液し、施設側の水系(または液―液熱交換)に熱を渡す。Schneider Electricは液冷が“高密度施設のデフォルト化”へ向かうとし、AIサーバーによってはファンが無い(=施設側液冷に依存)点も指摘しています。

- 液冷ラック/RDHx(リアドア熱交換):既存チラー水系を活かしやすく、ブラウンフィールド改修の現実解になりやすい。Motivair(Schneider Electricのポートフォリオ)はChilledDoorを“最大75kW/ラック・100%熱除去”級として提示しています(※製品仕様)。

- 浸漬冷却(immersion):サーバー全体を絶縁液に浸す方式で、特定用途で採用が進む一方、運用・保守・サプライチェーン・標準化の壁も大きい。Uptime Instituteでも浸漬はDLCの方式の一つとして把握されています。

主要企業の動きとして、VertivはDTC向けCDUファミリー拡充を発表しており、CDUは「kW級の熱輸送をラック外へ運ぶ“ポンプ付き電気機器”」として新たな設備カテゴリになっています。 CoolITはCDU・コールドプレート・マニホールド等を含む“DLC部材”を主要製品群として掲げ、サーバーOEMや半導体企業との協業を強調しています。 Submerは浸漬を含む液冷(Direct Liquid Coolingとimmersion)の両面を訴求し、AI向け液冷需要が前提化しているとの立場を示しています(※ベンダー見解)。

データセンター管理システム

AIデータセンター運用では、設備を「止めない」だけでなく、「高密度・高変動の状態を常時観測し、設計限界の近くで安全に走らせる」ことが重要になります。NVIDIAはDGX SuperPOD計画で、設計変更が電力・床レイアウト・ネットワーク(ケーブル長や遅延)に連鎖影響する点を明示しており、運用段階でも“相互依存の可視化”が価値になります。

管理システムは大きく三層です。

DCIM(Data Center Infrastructure Management):IT資産とファシリティ資産を統合的に捉え、キャパシティ計画・変更管理・モデリングを行う領域。Schneider ElectricはDCIMとしてEcoStruxure IT(IT Advisor等)を提供し、資産・計画・運用の統合を訴求しています。 VertivもTrellisをDCIMとして位置づけ、ITと設備資産の統合ビューを提供すると説明しています(※同製品は「製造終了」表示あり)。

エネルギー/電源監視(EPMS/Power Monitoring):受配電・UPS・発電・冷却等を含む電力系統の健全性とエネルギー使用を監視する領域。EPMSは電力使用と電気ネットワークの状態把握を目的とする、とする説明があります。

設備・建屋管理(BMS/Building Management):冷却・電源・セキュリティ等の建物システムを統合監視・制御する領域。SiemensはDesigo(Desigo CC等)を統合ビル管理として提示し、データセンターを含む要求の高い用途に対応するとしています。 また同社事例では、Desigo CCと電力可視化(Power Manager)で電気インフラをダッシュボード化し、リアルタイム/履歴データで分析・警報・KPI監視を行う旨が述べられています。

AI時代は「設備のデジタル化=CapEx最適化とOpex安定化」に直結します。特に液冷は“システムでありSKUではない”と指摘され、バルブCv、ポンプ曲線、ΔT制御、制御ロジック等の統合設計が失敗要因になり得るため、制御・監視まで含めた参入が鍵になります。

AIデータセンター設備産業の構造と日本企業へのインプリケーション

AIデータセンター設備市場を、ユーザー指定の5セグメント(GPUサーバー/ネットワーク/電源設備/冷却設備/管理システム)で見た場合、重要性は「GPUそのもの」よりも、“GPU密度を上げても止めずに動かすための周辺設備”で急上昇しています。米国ではデータセンター電力需要が急拡大し、系統・設備の制約が建設の律速になり得ることが公的にも示されているため、インフラ供給側(電力・冷却・工業化建設)が競争力の源泉になりやすい環境です。

セグメント別の“市場の厚み”を、設備側の観点で要約します。

- GPUサーバー:性能進化サイクルが短く(Schneider Electricは12〜18か月を示唆)、設備側は「世代更新に耐える熱・電力の包絡線(thermal envelope / power envelope)」設計が必要です。 ここへの参入は完成品以外にも、ラック統合・熱設計・検証(validation)で可能性があります。

- ネットワーク:スケールアウト性能がクラスタ性能を規定し、GPUあたりNIC 1枚級の要求が出るため、光部品・配線・ケーブルマネジメント・運用自動化までが“設備化”します。

- 電源設備:高密度ラックでは配電方式が規定され、冗長性も複雑化します。さらに800VDCや蓄電統合など、電源アーキテクチャ転換期に入りつつあります。

- 冷却設備:DLC採用が進み、CDU/RDHx/配管・水質管理・検知・制御が“新たな建屋内設備の主役”になります。

- 管理システム:DCIM+EPMS+BMSの統合が重要になり、デジタルツインや運用最適化と結びつくことで、単なる監視から“設計・施工・運用一体”へ価値が移ります。

日本企業にとっての参入余地は、米国で不足しがちな「高密度・高信頼の電力・熱・工業化(モジュール化)・統合検証」の供給能力にあります。特に以下の“具体領域”が現実的です(企業名は例示)。

日本の電機メーカーは、サーバーそのものよりも、電源・制御・監視・電力変換で勝ち筋が出ます。たとえば 日本電気 や 富士通 はIT運用・管理ソフトやシステム統合の経験値を、DCIM/運用自動化側へ展開しやすい立ち位置です。

重電メーカーは、受配電・変圧・遮断・電力変換・直流配電(将来の800VDC含む)といった“電源アーキテクチャ転換”に直接関与できます。NVIDIAの800VDC構想は、コネクタ、バスバー、保護、蓄電統合など広範な部材・安全設計を必要とし、ここは 三菱電機、日立製作所、富士電機、東芝 などが強みを持つ領域です。

インフラ企業(エネルギー/通信/運用)は、電力調達・オンサイト電源・需要変動(power bursting)対策・運用最適化で価値を出せます。AI負荷は同期により急峻な負荷変動を起こし得るため、電力会社・規制・系統運用まで含む調整力が競争力になります。 たとえば NTTデータ のようなSI/運用系は、建設後の“オペレーション・サービス化”へ入り込む余地があります。

建設会社は、AIデータセンターを「工場生産+現場組立」の工業製品に近づける潮流(モジュール化・短納期)に対応できるかが勝負です。Vertivは“ギガワット級を速度で作る”ために、電力・冷却・ITを組み合わせたモジュール化を強調しています。 日本のゼネコン(例:大林組、鹿島建設、清水建設)は、クリーンルームやプラントで培った工程管理・品質管理・安全管理を、データセンターの“標準化設計+高速施工+コミッショニング”へ移植できる可能性があります。

結論として、米国AIデータセンター設備産業は「GPUが主役であるほど、建屋内インフラがボトルネックになる」産業です。電源(AC→高電圧DC)と冷却(空冷→液冷)の転換期にあり、ネットワークもEthernet/InfiniBand双方で高度化し、管理はDCIM/EPMS/BMS統合へ進んでいます。日本企業の現実的な参入戦略は、単品供給ではなく、(1)高密度ラック対応の標準アーキテクチャ、(2)液冷・直流配電などの次世代設備部材、(3)統合検証と運用を含む“システム提供”に寄せるほど成功確率が上がります。

引用資料

- DOE Releases New Report Evaluating Increase in Electricity Demand from Data Centers (Dec 20, 2024)

- 2024 United States Data Center Energy Usage Report (LBNL, Dec 2024) [PDF]

- Uptime Institute Global Data Center Survey 2024 (Jul 2024) [PDF]

- Uptime Institute 2024 Cooling Systems Survey: Direct Liquid Cooling Results (May 2024) [PDF]

- Strategic Industries Surging: Driving US Power Demand (Grid Strategies, Dec 2024) [PDF]

- NVIDIA DGX SuperPOD Data Center Design: DGX H100 (DG-11301-001) [PDF]

- NVIDIA DGX SuperPOD (H100) Data Center Design Guide: Electrical Specifications

- NVIDIA Quantum-2 InfiniBand Platform

- NVIDIA Spectrum-X Ethernet Platform

- High-Performance Ethernet Networking for Artificial Intelligence Systems (Arista/Broadcom, Jul 2025) [PDF]

- Cisco Nexus 9000 Series Switches for AI Clusters (White Paper, Jun 2025)

- Dell PowerEdge XE9680 Specification Sheet [PDF]

- HPE Cray XD670 QuickSpecs [PDF]

- NVIDIA 800 VDC Architecture Will Power the Next Generation of AI Factories (May 2025)

- Schneider Electric Announces New Solutions to Address the Energy and Sustainability Challenges Spurred by AI (Dec 4, 2024)

- Schneider Electric Announces New Reference Designs… Supporting NVIDIA Mission Control and NVIDIA GB300 NVL72 (Sep 18, 2025)

- Schneider Electric Highlights Innovation in 800 VDC Power Systems… (Oct 13, 2025)

- Eaton unveils next-generation architecture to advance 800 VDC power infrastructure… (Oct 13, 2025)

- Vertiv Frontiers 2026 Report (Jan 2026) [PDF]

- Data Center Vision: How Data Center Infrastructure Will Evolve to Support AI and Accelerated Compute (Vertiv/IDC, Mar 2025) [PDF]

- Vertiv 360AI Reference Design 026 [PDF]

- Vertiv Expands Liquid Cooling Portfolio… (Jun 3, 2025)

- CoolIT Systems CHx200 Rack CDU

- Submer Immersion Cooling: SmartPod EVO

- Data Centers Reference Architecture IV: BMS & EPMS (Siemens, 2025) [PDF]

- TechTarget: Building Management System (BMS) definition (Apr 2024)

- Janitza: EPMS definition (Mar 2024)